Indice

ToggleFotos, vídeos e áudios produzidos por inteligência artificial já circulam em massa pelos canais digitais. Com softwares gratuitos e ferramentas on-line, qualquer pessoa consegue criar conteúdos falsos que imitam vozes conhecidas, trocam rostos em vídeos ou inventam fotografias hiper-realistas. Esse fenômeno, conhecido como deepfake, coloca em xeque a confiança em tudo o que é compartilhado na rede.

Explosão de deepfakes amplia riscos on-line

O termo deepfake combina “deep learning” (aprendizado profundo) e “fake” (falso). Antes restritas a profissionais de efeitos visuais, as técnicas foram popularizadas por serviços web que geram imagens ou vozes com poucos cliques. Criminosos passaram a usar a tecnologia em golpes comuns, como o “golpe do parente” por telefone, no qual a voz da vítima é clonada para pedir dinheiro em suposta emergência. Há ainda montagens de políticos declarando frases inexistentes ou celebridades promovendo produtos sem autorização.

Em paralelo à disseminação dessas fraudes, surgiram soluções gratuitas para identificar conteúdo artificial. Elas analisam padrões de cor, texturas, inconsistências anatômicas e outros detalhes que escapam à percepção humana.

Ferramentas de detecção: resultados variáveis

Desenvolvido pela Universidade de Buffalo (EUA), o Deepfake-o-Meter reúne 16 algoritmos de código aberto e aceita imagens, vídeos e áudios. O acesso exige apenas cadastro por e-mail, que concede 30 créditos (um por análise). Testes revelaram limitações: a famosa foto do Papa Francisco com jaqueta acolchoada foi apontada como falsa por apenas duas das 16 soluções; já um retrato criado no Canva teve sete detecções positivas.

Outra opção, a Sightengine, entrega respostas em segundos e indicou 99% de probabilidade de falsificação no mesmo retrato do Canva, mas mostrou incerteza (53%) diante da imagem do Papa. Esses números evidenciam que nenhum detector é infalível.

No campo dos vídeos, o Deepware.ai não identificou montagens elaboradas com o gerador Sora, da OpenAI. Por outro lado, o serviço Hive atribuiu 99% de chance de deepfake aos mesmos clipes, ainda que limite uploads gratuitos a 20 segundos.

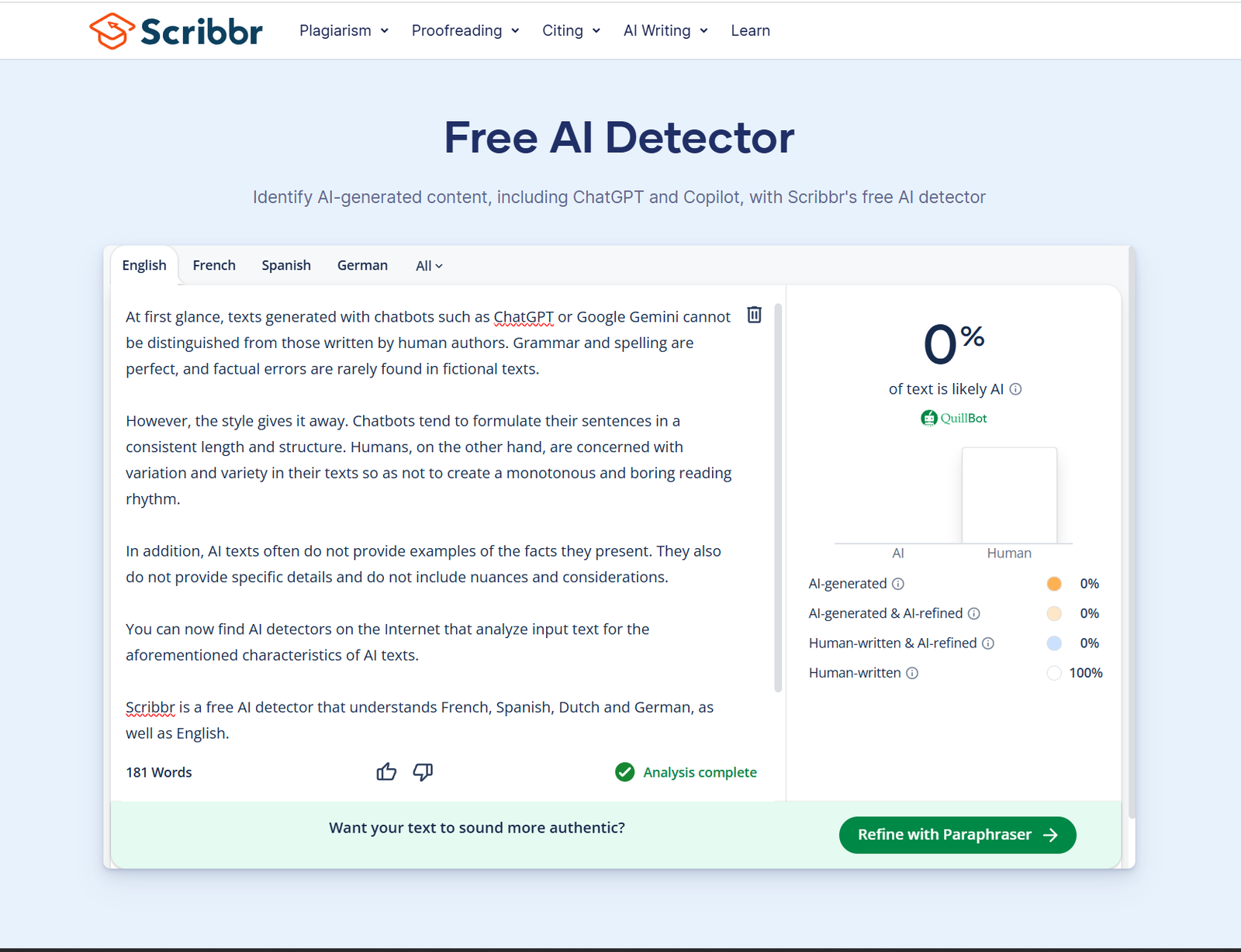

Textos criados por chatbots também podem ser analisados. O Scribbr avalia produções em vários idiomas sem custo, enquanto o Isgen.ai oferece 12 000 palavras mensais no modo gratuito. Ambos buscam padrões de frase e ausência de detalhes específicos, traços comuns em textos sintéticos.

Erros visuais e sonoros que entregam a fraude

Apesar dos avanços, muitas falsificações apresentam falhas perceptíveis:

Mãos e dedos: números inconsistentes ou proporções fora do normal são frequentes, pois a IA nem sempre entende quantos dedos aparecem em fotos de referência.

Pernas e braços: membros podem surgir em posições impossíveis ou sem correspondência com o corpo.

Cabelos: fios se sobrepõem de forma antinatural ou parecem “soltos” do couro cabeludo.

Objetos e roupas: botões duplicados, colares abertos e armações de óculos deformadas chamam atenção.

Textos na imagem: letras borradas ou ilegíveis continuam sendo um indicativo clássico.

Sombras e proporções: luzes incompatíveis e diferenças de resolução entre a figura principal e o fundo entregam a montagem.

Imagem: Jörn via pcworld.com

Em vídeos, rostos sem expressão, ausência de piscadas e movimentos lentos reforçam o alerta. Já no áudio, entonação monótona e cortes abruptos podem denunciar vozes clonadas.

Recursos extras para voz e mensagens

Soluções focadas em áudio incluem o McAfee Deepfake Detector, disponível em PCs com processadores Intel Core Ultra 200V, e o Hiya AI Voice Detector, extensão gratuita para Chrome que avalia gravações on-line. Para mensagens de texto, o Bitdefender Scamio usa IA para identificar tentativas de phishing em e-mails, SMS ou links suspeitos.

Dica Bônus

Antes de compartilhar uma imagem duvidosa, amplie a foto e examine mãos, escritos e sombras. Pequenas incoerências costumam revelar o deepfake sem necessidade de ferramentas.

FAQ

1. O que é deepfake?

É um conteúdo forjado com IA que simula fotos, vídeos ou áudios autênticos.

2. Quais são os golpes mais comuns?

Pedidos de dinheiro por voz clonada, campanhas políticas falsas e anúncios com celebridades sem consentimento.

3. Como funciona o Deepfake-o-Meter?

Combina 16 algoritmos de código aberto e retorna a probabilidade de falsificação mediante upload do arquivo.

4. Sightengine é gratuito?

Oferece plano grátis com limites de uso; análises são quase imediatas.

5. Existe detector infalível?

Não. Cada ferramenta apresenta margem de erro e resultados variam conforme o material.

6. Textos de IA podem ser reconhecidos?

Sim. Serviços como Scribbr e Isgen.ai buscam padrões linguísticos típicos de chatbots.

7. Quais sinais visuais observar?

Mãos deformadas, textos borrados, sombras incoerentes e objetos impossíveis.

8. Como proteger áudios?

Use detectores de voz, valide ligações suspeitas por outro canal e desconfie de pedidos urgentes.

Conclusão

Deepfakes avançam rapidamente, mas a combinação de ferramentas de detecção, observação atenta aos detalhes e verificação de fontes continua sendo a melhor defesa para quem navega no ambiente digital.